پارلمان اروپا قانون هوش مصنوعی اتحادیه اروپا (EU) را در مارس 2024 تصویب کرد، و هدف آن این است که به توسعه دهندگان و مجریان هوش مصنوعی (AI) چیزی را ارائه دهد که سیاستگذاران اتحادیه اروپا اینطور توصیف می کنند.الزامات روشن و تعهدات مربوط به کاربردهای خاص هوش مصنوعی.

آنها همچنین امیدوارند که مقررات بار اداری و مالی را بر مشاغل، به ویژه شرکت های کوچک و متوسط (SMEs) کاهش دهد.

این قانون با هدف ارائه یک چارچوب قانونی برای مدیریت سیستم های هوش مصنوعی با تاکید بر ایمنی، حریم خصوصی و جلوگیری از به حاشیه راندن انسان ها. تعدادی از موارد استفاده برای پیاده سازی هوش مصنوعی وجود دارد از قانون مستثنی شده است. با این حال، برخی از منتقدان آن معتقدند که حفره های بسیار زیادی وجود دارد، به ویژه در مورد امنیت ملیکه ممکن است اثربخشی آن را محدود کند.

دلیل اینکه اتحادیه اروپا و سایر حوزههای قضایی به دنبال رفع نگرانیهای ایمنی هوش مصنوعی هستند این است که چنین سیستمهایی را میتوان بر روی دادههایی آموزش داد که میتوانند در طول زمان تغییر کنند.

گروه هوش مصنوعی سازمان همکاری اقتصادی و توسعه (OECD) هشدار می دهد که سیستم های مبتنی بر هوش مصنوعی تحت تأثیر پویایی های اجتماعی و رفتار انسانی هستند.

خطرات و مزایای هوش مصنوعی میتواند ناشی از تأثیر متقابل جنبههای فنی همراه با عوامل اجتماعی مربوط به نحوه استفاده از یک سیستم، تعامل آن با سایر سیستمهای هوش مصنوعی، افرادی که آن را اجرا میکنند و زمینه اجتماعی که در آن مستقر شده است، باشد.

به طور کلی، قوانین هوش مصنوعی بر استفاده مسئولانه از سیستمهای هوش مصنوعی متمرکز است که شامل نحوه آموزش آنها، سوگیری دادهها و توانایی توضیح اینکه در کجا خطاها میتوانند تأثیر مخربی بر یک فرد داشته باشند، میشود.

https://www.youtube.com/watch?v=_1-A2TSKOHE

OECD Policy Observatory.ai چارچوب مدیریت ریسک هوش مصنوعی اشاره میکند که تغییراتی که در دادههای آموزشی هوش مصنوعی رخ میدهد گاهی اوقات میتواند بهطور غیرمنتظرهای بر عملکرد و قابلیت اطمینان سیستم تأثیر بگذارد، به گونهای که درک آن دشوار است. رصدخانه سیاست OECD.ai هشدار میدهد که سیستمهای هوش مصنوعی و زمینههایی که در آن مستقر میشوند، اغلب پیچیده هستند و تشخیص و پاسخ به خرابیها را در صورت وقوع مشکل میسازند.

قانون هوش مصنوعی اتحادیه اروپا یک رویکرد مبتنی بر ریسک برای ایمنی هوش مصنوعی با چهار سطح خطر برای سیستمهای هوش مصنوعی و همچنین شناسایی خطرات خاص برای یک مدل هدف کلی اتخاذ میکند.

این بخشی از یک بسته گسترده تر از اقدامات سیاستی برای حمایت از توسعه هوش مصنوعی قابل اعتماد است که شامل بسته نوآوری هوش مصنوعی و برنامه هوش مصنوعی هماهنگ نیز می شود. اتحادیه اروپا می گوید این اقدامات ایمنی و حقوق اساسی افراد و مشاغل را در مورد هوش مصنوعی تضمین می کند و پذیرش، سرمایه گذاری و نوآوری در هوش مصنوعی را در سراسر اتحادیه اروپا تقویت می کند.

نکات کلیدی قانون هوش مصنوعی اتحادیه اروپا

قانون مجموعه ای از حفاظت ها را فراهم می کند برای هوش مصنوعی هدف عمومی توسعه دهندگان چنین سیستم هایی باید مستندات فنی را تهیه کنند تا اطمینان حاصل کنند که هوش مصنوعی با قانون حق چاپ اتحادیه اروپا مطابقت دارد و خلاصه های مفصلی از محتوای مورد استفاده برای آموزش را به اشتراک بگذارند. قوانین مختلفی را برای سطوح مختلف ریسک تعیین می کند.

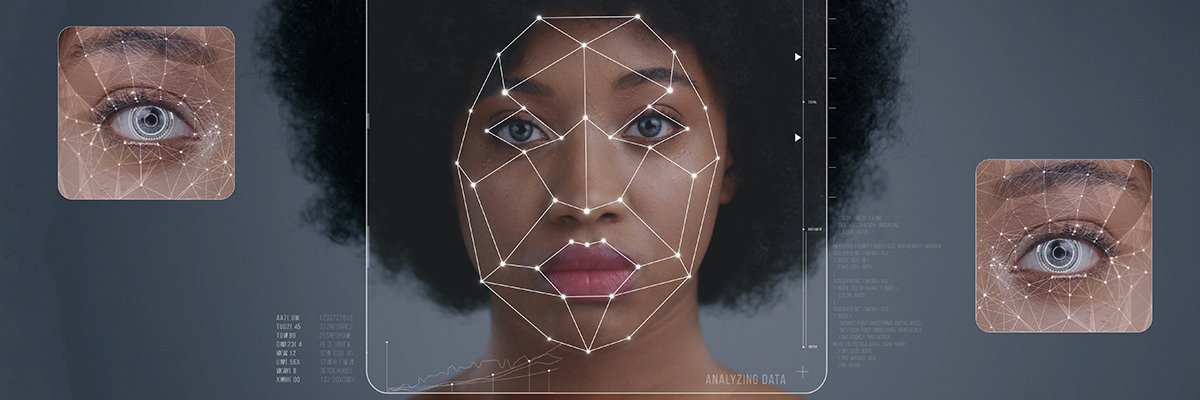

تحت مقوله «خطر غیرقابل قبول»، قانون به دنبال محدود کردن استفاده از سیستمهای شناسایی بیومتریک توسط سازمانهای مجری قانون بود. سیستم های طبقه بندی بیومتریک که از ویژگی های حساس استفاده می کنند (مانند عقاید سیاسی، مذهبی و فلسفی، گرایش جنسی و نژاد) ممنوع هستند.

هوش مصنوعی پرخطر تحت پوشش قانون شامل سیستمهای هوش مصنوعی است که در محصولات تحت پوشش قوانین ایمنی محصولات اتحادیه اروپا استفاده میشوند. این شامل اسباب بازی، حمل و نقل هوایی، اتومبیل، تجهیزات پزشکی و آسانسور است. همچنین هوش مصنوعی مورد استفاده در طیف وسیعی از نقشهای پشتیبانی تصمیمگیری، مانند اجرای قانون، پناهندگی، مهاجرت و کنترل مرز، آموزش، اشتغال و مدیریت زیرساختهای ملی حیاتی را پوشش میدهد.

محصولاتی که در گروه پرخطر قرار می گیرند باید قبل از عرضه به بازار و همچنین در طول چرخه عمرشان مورد ارزیابی قرار گیرند. این قانون به مردم این حق را می دهد که شکایت خود را در مورد سیستم های هوش مصنوعی به برخی مقامات ملی ارائه کنند. هوش مصنوعی (GenAI)، مانند ChatGPT، به عنوان پرخطر طبقه بندی نمی شود. در عوض، قانون بیان می کند که چنین سیستم هایی باید با الزامات شفافیت و قانون کپی رایت اتحادیه اروپا مطابقت داشته باشند.

قانون هوش مصنوعی اتحادیه اروپا بر چه کسانی تأثیر می گذارد؟

استفان کاتانزانو، تحلیلگر ارشد در Enterprise Strategy Group، خاطرنشان می کند که قانون AI برای ارائه دهندگان سیستم های هوش مصنوعی اعمال می شود. او میگوید که این بدان معناست که شرکتهایی را پوشش میدهد که سیستمهای هوش مصنوعی را توسعه داده و میفروشند یا چنین سیستمهایی را تحت نام یا علامت تجاری خود، خواه با هزینه یا رایگان، در دسترس قرار میدهند.

کاتانزانو در ادامه خاطرنشان میکند که قانون هوش مصنوعی واردکنندگان و توزیعکنندگان سیستمهای هوش مصنوعی در اتحادیه اروپا و همچنین «توزیعکنندگان» را که به عنوان اشخاص حقیقی یا حقوقی از هوش مصنوعی تحت هدایت خود در فعالیتهای حرفهای خود استفاده میکنند، پوشش میدهد.

تحلیلگر ارشد انزا یانوپولو او میگوید که علیرغم فقدان جزئیات در مورد استانداردها و پروتکلهای فنی، او از سازمانها میخواهد تا برای اندازهگیری و گزارش اثربخشی سیستمهای هوش مصنوعی خود آماده شوند. به گفته ایانوپولو، این شاید یکی از چالش های اصلی الزامات جدید باشد.

او در یک پست وبلاگی که قانون را پوشش می دهد، نوشت: «شرکت ها باید با اندازه گیری عملکرد سیستم های هوش مصنوعی و GenAI خود در برابر اصول حیاتی هوش مصنوعی مسئول، مانند تعصب، تبعیض و بی عدالتی، شروع کنند.

با ظهور استانداردها و مشخصات فنی جدید، انتظار می رود متن بخشی از قانون گسترش یابد.

اتحادیه اروپا از نظر مقررات هوش مصنوعی چه تفاوتی با سایر مناطق دارد؟

در هر منطقه ای که یک سازمان در آن فعالیت می کند، اگر بخواهد هوش مصنوعی را در جای دیگری مستقر کند، باید چارچوب نظارتی را هم در کشور خود و هم در سایر مناطقی که سیستم مورد استفاده قرار می گیرد، درک کنند. در زمان نگارش این مقاله، اتحادیه اروپا رویکردی مبتنی بر ریسک را اتخاذ کرده است.

با این حال، کشورهای دیگر رویکردهای متفاوتی برای مقررات هوش مصنوعی در پیش گرفته اند. اگرچه حوزه های قضایی مختلف در رویکرد نظارتی متفاوت هستند، اما مطابق با هنجارهای فرهنگی و زمینه های قانونی مختلف، EY اشاره می کند آنها به طور گسترده در تشخیص نیاز به کاهش مضرات بالقوه هوش مصنوعی و در عین حال اجازه استفاده از آن برای منافع اقتصادی و اجتماعی برای شهروندان، همانطور که توسط OECD تعریف شده و توسط G20 تأیید شده است، توافق دارند. این موارد شامل احترام به حقوق بشر، پایداری، شفافیت و مدیریت ریسک قوی است.

طرح کلی چارچوب نظارتی هوش مصنوعی دولت بریتانیا، که در فوریه منتشر شد، یک رویکرد “طرفدار نوآوری” را ارائه می دهد. مشاهده این شناخت نیاز به راهنمایی امیدوارکننده است، اما اصول غیرقانونی بر روی بازیگران کلیدی درگیر در توسعه هوش مصنوعی متمرکز است.

برای تقویت نوآوری فراگیر، بریتانیا باید تا آنجا که ممکن است صداهای بیشتری را در شکل دادن به چشم انداز نظارتی وارد کند. این با توجه به گاوین پولمدیرعامل Here East به این معنی است که سیاستگذاران و تنظیمکنندهها باید نه تنها با شرکتهای بزرگ فناوری، بلکه با استارتآپها، مؤسسات آموزشی و کسبوکارهای کوچکتر مشارکت فعال داشته باشند.

او میگوید: «تصویب قانون پیشگامانه هوش مصنوعی اتحادیه اروپا زنگ خطری برای بریتانیا است – یادآوری این که ما باید دستورالعملهای خود را تطبیق داده و تکامل دهیم تا جلوتر از منحنیها باقی بمانیم». سناریوی ایده آل چارچوبی است که رشد را تشویق می کند و روی استعدادهای محلی و پتانسیل آینده سرمایه گذاری می کند تا موقعیت ما را به عنوان یک رهبر جهانی در نوآوری هوش مصنوعی تقویت کند.

اهمیت تأثیر متقابل

رویکرد اتحادیه اروپا بسیار متفاوت از رویکرد ایالات متحده است. به گفته ایوانا بارتولتی، مدیر ارشد حریم خصوصی و مدیریت هوش مصنوعی در Wipro، این در واقع چیز خوبی است. او می گوید: «لقاح متقابل و تأثیر متقابل مورد نیاز است زیرا ما بهترین راه را برای مدیریت این فناوری قدرتمند پیدا می کنیم.

همانطور که بارتولتی اشاره می کند، در حالی که قوانین ایالات متحده و اتحادیه اروپا تا حدودی متفاوت هستند، این دو استراتژی نشان دهنده همگرایی در برخی از عناصر کلیدی است. به عنوان مثال، تمرکز بر انصاف، ایمنی و استحکام وجود دارد. همچنین یک تعهد قوی و اقدام محکم برای ایجاد تعادل بین نوآوری و تمرکز قدرت در شرکت های بزرگ فناوری وجود دارد.

چین همچنین در تنظیم مقررات هوش مصنوعی پیشرفت چشمگیری داشته است. رویکرد او قبلاً به جای ایجاد یک رژیم نظارتی جامع برای سیستمهای هوش مصنوعی، بر حوزههای خاصی از هوش مصنوعی متمرکز بود. مثلا، جیمی رولندزشریک، و انگوس میلن، از همکاران Haseltine Lake Kempner، خاطرنشان می کنند که چین قوانین جداگانه ای را برای الگوریتم های توصیه، GenAI و دیپ فیک معرفی کرده است. آنها می گویند که به نظر می رسد این رویکرد به جای اینکه فعالانه به دنبال شکل دادن به این توسعه باشد، به توسعه هوش مصنوعی واکنش نشان داده است.

در ژوئن 2023، چین تایید کرد که روی قانون هوش مصنوعی کار می کند. در حال حاضر مشخص نیست که قانون جدید چه مواردی را پوشش می دهد زیرا این پیش نویس هنوز منتشر نشده است، اما انتظار می رود که هدف آن ارائه یک چارچوب نظارتی جامع باشد و بنابراین به طور بالقوه از نظر دامنه و جاه طلبی با قانون هوش مصنوعی اتحادیه اروپا رقابت می کند.

تاثیر آن بر بخش هوش مصنوعی اروپا چیست؟

انجمن آلمان برای هوش مصنوعی هشدار داد که قانون هوش مصنوعی اتحادیه اروپا در شکل فعلی خود به طور جدی بر اکوسیستم هوش مصنوعی اروپا تأثیر منفی خواهد گذاشت و رقبای ایالات متحده و چین را به طور بالقوه در یک نقطه ضعف رقابتی قرار می دهد.

در مقالهای که در مورد موضع او بحث میکند، او هشدار داد که هوش مصنوعی همه منظوره و مدلهای زبان بزرگ باید کنار گذاشته شوند، یا حداقل بهطور قطعی به عنوان موارد استفاده پرخطر طبقهبندی شوند.

نویسندگان مقاله «ما برای ارزیابی مجدد الزامات فعلی که سیستمهای هوش مصنوعی را به عنوان موارد استفاده پرخطر طبقهبندی میکنند، حمایت و ترویج سرمایهگذاریهای اروپایی در مدلهای زبانی بزرگ و مدلهای چندوجهی، و شفافسازی تعاریف نامشخص و عبارتهای انتخاب شده را میخواهیم». روزنامه نوشت